Die meisten Kalibriertechniker nutzen in ihren Betrieben bewährte Kalibrierverfahren, die sich häufig nicht mit der Messtechnik der Instrumentierung weiterentwickelt haben. Vor vielen Jahren war die Einhaltung einer Messunsicherheit von ±1% der Messspanne schwierig; die heutige Gerätetechnik überschreitet dieses Niveau jedoch problemlos. Die Techniker verwenden in einigen Fällen alte Kalibriergeräte, die nicht den Spezifikationen neuer Technologien der Messtechnik entsprechen.

In diesem Dokument konzentrieren wir uns auf die Erstellung einer Basis für die Prüfung der Leistungsfähigkeit. Dazu erfolgt die Analyse und ggfs. Anpassung von Prüfparametern (hauptsächlich bezogen auf Toleranzen, Intervalle und Prüfpunktschemata), um optimale Leistungen zu erreichen.

Das Risiko-Management wird darüber hinaus erörtert – dies sind regulatorische und sicherheitstechnische Parameter, Qualitätsparameter, Ausfallzeiten und andere kritische Parameter. Ein gutes Verständnis dieser Variablen hilft bei der Entscheidung die Prozessmesstechnik der Anlage bestmöglich zu kalibrieren und veraltete Verfahren zu optimieren.

Laden Sie sich diesen Artikel als pdf-Datei herunter >>

Inhaltsverzeichnis:

- Einführung und Hintergrund

- Grundlagen der Kalibrierprüfung

- Kalibriertrendanalyse und Kosten

- Kalibrierkosten

- Fazit

Einführung und Hintergrund

Eine kurze Einführung in die in diesem Beitrag diskutierten Themen:

Wie oft sollte kalibriert werden?

Die grundlegendste Frage, mit der sich Kalibrierfachleute in Anlagen konfrontiert sehen, ist wie oft ein Prozessmessgerät kalibriert werden sollte. Hierfür gibt es keine Standardantwort, da es viele die Leistung der Geräte beeinflussende Variablen gibt; und somit das entsprechende Prüfintervall beeinflussen. Hierzu gehören:

- Herstellerrichtlinien (damit zu beginnen ist ein guter Ausgangspunkt)

- Genauigkeitsanforderungen des Herstellers

- Stabilitätsvorgaben (kurzfristige vs. langfristige)

- Anforderungen an die Prozessgenauigkeit

- Typische Umgebungsbedingungen (raue vs. klimatisierte)

- Anforderungen an regulatorische- oder Qualitätsstandards

- Folgekosten bei Ausfällen

„bestanden/nicht bestanden“-Toleranz

Wie hoch die „bestanden/nicht bestanden“-Toleranz ist, ist eine wichtige Frage bei der Erstellung einer Kalibrierstrategie. Auch hier gibt es keine eindeutige Antwort. Die Meinungen gehen weit auseinander. Es wird häufig wenig Rücksicht darauf genommen, was wirklich erforderlich ist, um eine Anlage sicher zu betreiben und ein Qualitätsprodukt gleichzeitig effizient herzustellen. Ein guter Anfang wäre eine kritische Analyse des Geräts. Die Toleranz ist jedoch eng verbunden mit der Frage zum Kalibrierintervall. Eine geringe Toleranz erfordert möglicherweise häufigere Tests mit sehr genauem Kalibrier-Equipment; während bei einer weniger kritischen Messung mit einem sehr genauen Kalibrator das Kalibrierintervall auf „mehrere Jahre“ verlängert werden kann.

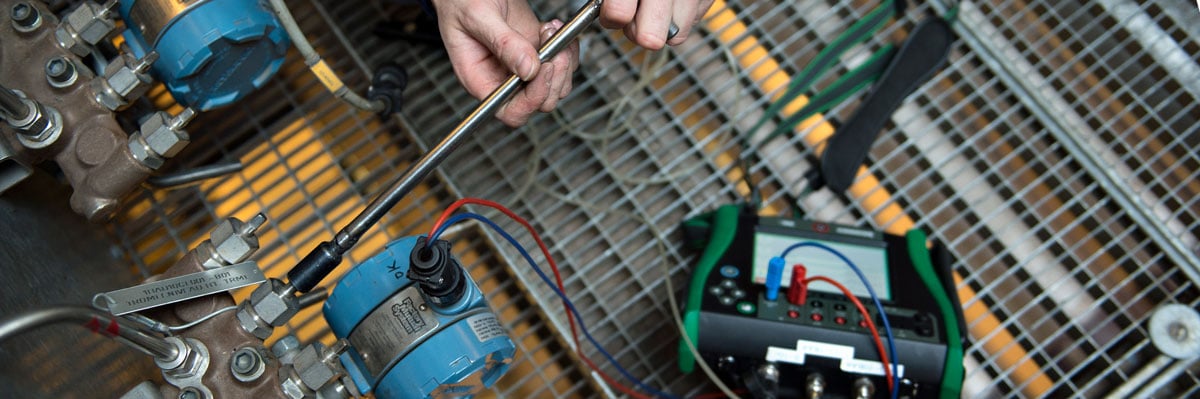

Kalibrierverfahren

Geeignete Prüfverfahren und -praktiken festzulegen und umzusetzen ist eine weitere Aufgabe. Meistens haben sich an einem Standort die Verfahren im Laufe der Zeit nicht weiterentwickelt. Oftmals wenden Kalibriertechniker Praktiken an, die vor vielen Jahren eingeführt wurden; nicht selten werden daher Äußerungen getätigt wie „So haben wir es schon immer gemacht“. Unterdessen verbessert sich die Messtechnik weiter und wird immer präziser. Sie wird auch immer komplexer. Warum einen Feldbus-Transmitter mit dem gleichen Ansatz wie einen pneumatischen Transmitter prüfen? Die Durchführung der standardmäßigen Fünf-Punkte-Kalibrierung (aufwärts-/abwärts-Prüfung) mit einer Fehlerrate von weniger als 1% – oder gar 2% – der Messspanne eignet sich nicht für die heutigen anspruchsvolleren Anwendungen. In dem Maße, wie sich die Messtechnik verbessert, sollten sich auch die Vorgehensweisen und Verfahren des Kalibriertechnikers verbessern.

Das Optimum finden...

Die Betriebsleitung sollte sich darüber im Klaren sein, dass die Kosten für eine präzise Messung umso höher sind, je geringer die Toleranzen ausfallen. Tatsache ist, dass alle Geräte bis zu einem gewissen Grad driften. Zudem sollte beachtet werden, dass jedes Gerät eines bestimmten Herstellers/ eines bestimmten Modells eine einzigartige „Eigenschaft“ innerhalb einer spezifischen Prozessanwendung mitbringt. Der einzig richtige Weg, die optimalen Prüfparameter zu bestimmen, ist die Kalibrierung so aufzuzeichnen, dass Leistung und Drift analysiert werden können. Mit hochwertigen Daten und Prüfgeräten kann die geringste praktikable Toleranz innerhalb eines bestmöglichen Zeitplans eingehalten werden. Sind diese Parameter einmal festgelegt, können die damit verbundenen Kosten für die Durchführung einer Kalibrierung kalkuliert werden. Dadurch kann die Anschaffung eines hochwertigeren Instruments mit besseren Leistungsspezifikationen oder präziserer Kalibriergerätegeräte für noch bessere Prozessleistungen abgewogen werden.

Grundlagen der Kalibrierprüfung

Optimales Prüfintervall

Bei der Bestimmung eines geeigneten Prüfintervalls handelt es sich um eine auf Kenntnisse mehrerer Faktoren gestützte Annahme. Eine bewährte Methode ist die Festlegung eines eher konservativen Prüfintervalls basierend darauf, wie sich der Ausfall auf die Qualität und Effizienz bei der Produktherstellung auswirkt. Ebenfalls ist es wichtig zu bestimmen, welche Prüfungen minimale Auswirkungen auf den Anlagenbetrieb haben würden. Werden zunächst die kritischsten Geräte in Augenschein genommen, kann ein optimaler Zeitplan bei Verfügbarkeit von Personal für weniger kritische Prüfläufe festgelegt werden.

Da alle Geräte – unabhängig von Marke, Modell oder Technologie – driften, geben Anbieter sehr unterschiedliche Spezifikationen an, was den Leistungsvergleich letztlich erschwert. Oft werden umständliche Fußnoten in einer wenig zusammenhängenden Terminologie verfasst. Der Preis ist für die Geräteleistung auch nicht immer ausschlaggebend. Der einzige Weg, um ein ideales Intervall zu ermitteln, besteht darin Daten zu sammeln und die Drift für ein bestimmtes Fabrikat/Modell über einen bestimmten Zeitraum auszuwerten.

Beginnend bei einem konservativen Intervall, kann sich nach nur drei Kalibrierungen ein deutliches Driftmuster abzeichnen. Ein bestimmter Widerstandsthermometer (RTD)-Transmitter wird beispielsweise alle drei Monate kalibriert. Bei der zweiten Kalibrierung wird eine maximale Abweichung von +0,065% der Messspanne ermittelt. Bei der dritten Kalibrierung weitere +0,060% der Messspanne (+0,125% über 6 Monate). Obwohl für die Analyse eigentlich mehr Daten verwendet werden sollten, lässt sich vermuten, dass dieses Gerät pro Jahr um +0,25% driftet. Statistisch gesehen erhöht eine größere Datenmenge das Konfidenzniveau. Wenn sich dieses Driftmuster der im gesamten Betrieb verwendeten RTD-Transmitter der gleichen Marke/Modell wiederholt, könnte das optimale Intervall – für eine Messbereichstoleranz von 0,5% – mit sehr hohem Konfidenzniveau für 18 bis 24 Monate eingestellt werden.

Bei der Erfassung von Kalibrierdaten ist es entscheidend keine unnötigen Justagen vorzunehmen. Wenn die Toleranz beispielsweise ±1 % der Messspanne beträgt und das Gerät nur um -0,25 % der Messspanne ausfällt, sollte keine Justage vorgenommen werden. Wie kann die Drift (mindestens drei Punkte) bei ständiger Justage also analysiert werden? Für manche Personen mag es eine Herausforderung darstellen nicht zu justieren, jedoch wird die Analyse der Drift bei jeder durchgeführten Justage beeinträchtigt. Messlabore nehmen die Justage standardmäßig erst dann vor, wenn eine Toleranzspezifikation um 2/3 (oder ±0,67% mit einer Toleranz von ±1% der Messspanne) überschritten wird. Dasselbe gilt als bewährte Methode bei der Prozessmesstechnik. Dies kann für manchen Techniker möglicherweise eine Herausforderung sein; ein Justageniveau von weniger als die Hälfte der Toleranz beeinträchtigt jedoch die Driftanalyse.

Was aber, wenn die Drift unbeständig ist: mit der Zeit also zunimmt und wieder abnimmt? Demnach sind weitere Analysen erforderlich; verändern sich zum Beispiel die Umgebungsbedingungen ständig oder sind sie extrem? Je nach Prozessanwendung können Medien, Installationen, Durchflussleistung, Turbulenzen oder andere Variablen die Geräteleistung beeinflussen. Dies deutet auf ein “r“ im Zusammenhang mit der Drift hin. Sollte es der Fall sein, wird die Analyse eine Mischung aus zufälligem und systematischem Fehler aufzeigen.

Im Gegensatz zu kalkulierbaren systematischen Fehlern (Gerätedrift) entstehen zufällige Fehler durch unkontrollierbare Gegebenheiten (Umgebungsbedingungen und Prozessanwendung). Der Fokus auf systematische Fehler und/oder klare Driftmuster ermöglicht die Einstellung eines geeigneten Prüfintervalls, um die Betriebseffizienz auf sicherste Weise zu maximieren.

Für weitere Einzelheiten gibt es hier einen speziellen Blogbeitrag: Wie häufig sollten Instrumente kalibriert werden?

Ermittlung der richtigen Fehlergrenzen für die Prozesstoleranz

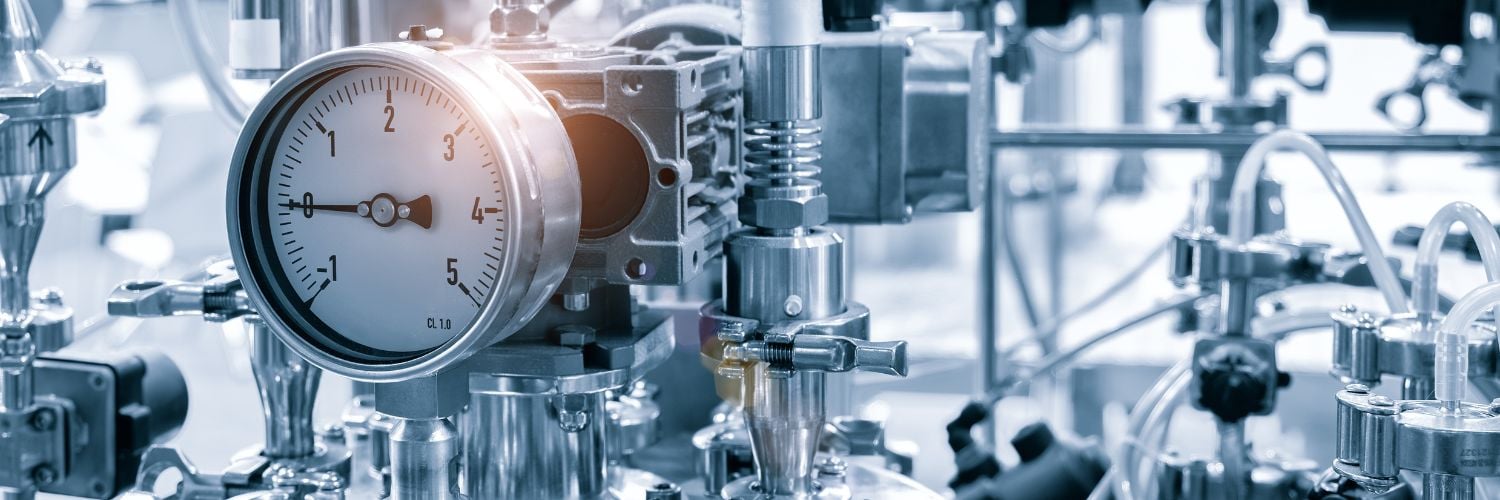

Genauigkeit, Prozesstoleranz, Fehlergrenze, zulässige Fehler, Abweichung, etc. – dies sind nur einige der vielen Begriffe, die zur Spezifizierung der Geräteleistung in einem bestimmten Prozess verwendet werden. Die Hersteller von Transmittern geben die Genauigkeit immer zusammen mit mehreren mit dem Fehler verbundenen Parametern an (Langzeitstabilität, Wiederholbarkeit, Hysterese, Referenzstandard und mehr). Für die Festlegung einer Prozesstoleranz ist die vom Hersteller vorgegebene Genauigkeit ein erster Anhaltspunkt ohne, dass es sich hierbei immer um eine zuverlässige Zahl handelt. Außerdem ist keine Messung besser als der zur Überprüfung eines Geräts verwendete Kalibrierstandard. Was steckt hinter der Genauigkeitsangabe eines von einem Hersteller gefertigten Präzisionsgeräts? Für die Druckerzeugung sollte eine entsprechende Druckwaage zum Laborinventar dazugehören. Im Betrieb gilt als Faustregel das Verhältnis 4:1 für die Unsicherheit des Kalibrators (Gesamtfehler) gegenüber der Toleranz für das Prozessmessgerät.

Um mehr über die Kalibrierunsicherheit zu erfahren, lesen Sie bitte den Blogbeitrag Messunsicherheit für Nicht-Mathematiker

Wenn für den Prozess eine Toleranz festgelegt wird, sollte ein zuständiger Techniker gefragt werden, welche Toleranz für den Prozess erforderlich ist, um sicherzustellen, dass hochwertige Produkte hergestellt werden. Beachten Sie, dass die Kalibrierkosten umso höher sind, je geringer die Toleranz ausfällt. Für die Einhaltung einer geringen Toleranz ist hochwertiges Kalibrier-Equipment erforderlich. Ob die Prüfung im Feld oder in der Werkstatt durchgeführt werden soll, ist ein weiterer wichtiger Punkt. Wenn das Driften der Messgeräte festgestellt wurde/bekannt ist, muss ein häufigeres Intervall berücksichtigt werden, um einen Messfehler abzufangen. Dies kann zu längeren Ausfallzeiten führen sowie durch die eigentlichen Kalibrierungen verbundene Kosten verursachen. Betrachten Sie die drei Grafiken zum Thema Geräteleistung:

Abbildung 1: Toleranz: ±0,1 % der Messspanne

.jpg?width=750&name=Graph%201_0%2c1%25_%20(GER).jpg)

Abbildung 2: Toleranz: ±0,25 % der Messspanne

.jpg?width=750&name=Graph%202_0%2c25%25_(GER).jpg)

Abbildung 3: Toleranz: ±1% der Messspanne

.jpg?width=750&name=Graph%203_1%25_(GER).jpg)

Beachten Sie, dass die erste Grafik einen „Ausfall“ anzeigt (fast das Doppelte des zulässigen Werts). In der zweiten Grafik wird angezeigt, dass eine Justage erforderlich ist (knapp bestanden) und in der dritten wird ein Transmitter in relativ gutem Zustand abgebildet. Die Prüfdaten sind für alle 3 Grafiken identisch. Der einzige Unterschied ist die Toleranz. Die Festlegung einer sehr geringen Toleranz von ±0,1 % der Messspanne kann unterschiedliche Probleme verursachen: Das Arbeiten mit einer größeren Anzahl von Abweichungsberichten sowie häufige Justagearbeiten belasten den Kalibriertechniker zusätzlich. Des Weiteren werden Messungen angezweifelt und vieles mehr. Die zweite Grafik ist nicht weniger problematisch. Es gibt zwar keinen Fehler, jedoch ist 0,25% der Messspanne immer noch eine geringe Toleranz und ständige Justagen erlauben weder eine Analyse der Drift noch die Bewertung von zufälligen oder systematischen Fehlern. In der dritten Grafik werden mehrere Vorteile aufgezeigt (beachten Sie, dass es sich bei ±1% der Messspanne immer noch um eine geringe Toleranz handelt). Sollte es zu einem Ausfall kommen, würde dies ein ungewöhnliches (und wahrscheinlich schwerwiegendes) Problem darstellen. Der Kalibriertechniker wird den Produktionsprozess weniger häufig stören und die Gesamtzeit für die Kalibrierungen fällt kürzer aus, da weniger Justagen vorgenommen werden. Gute Prüfgeräte, die eine ±1% der Messspannen-Leistungsspezifikation erfüllen, sind zu vernünftigen Preisen erhältlich.

Kritische Messungen erfordern eine niedrigere Toleranz und führen zu höheren Kalibrierkosten; gleichzeitig können aber qualifizierte Entscheidungen getroffen werden, indem die tatsächlichen Leistungsanforderungen im Verhältnis zu den damit verbundenen Kosten berücksichtigt werden. Allein die Wahl einer unzumutbar knappen Toleranz kann unnötige Probleme verursachen und ein Ungleichgewicht erzeugen. Am besten wäre es eine möglichst hohe Toleranz festzulegen, einige Leistungsdaten zu erfassen und daraufhin die Toleranz für optimale Ergebnisse anhand eines geeigneten Intervalls zu verringern.

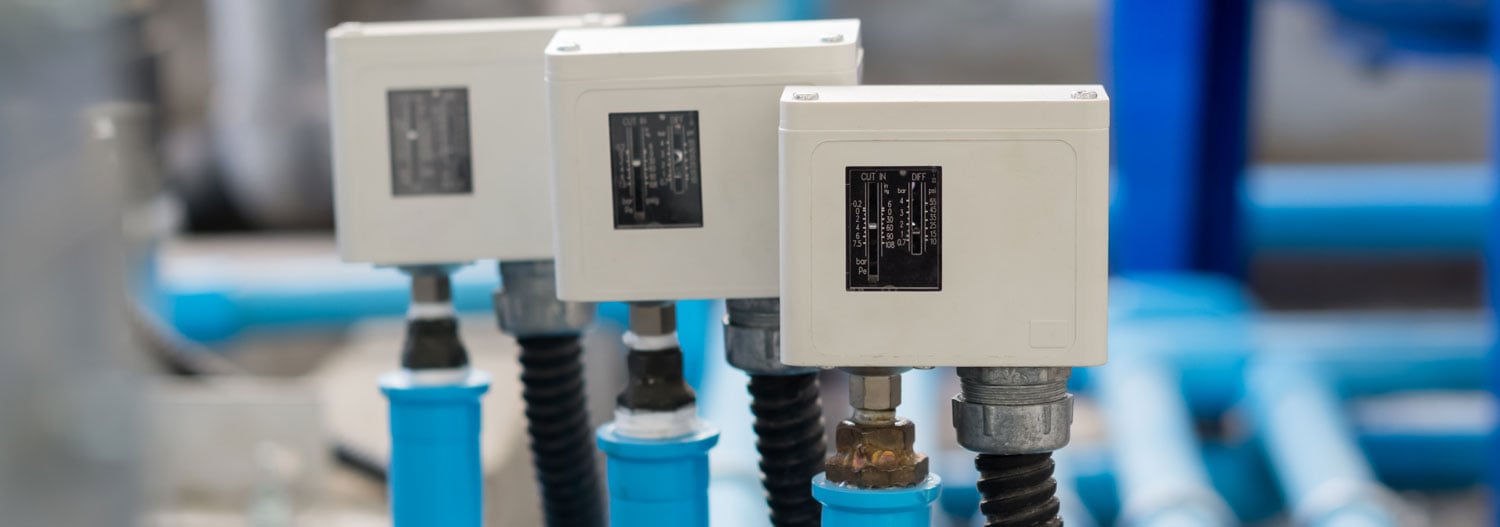

Test-Parameter

Ein kleines und dennoch wichtiges Detail ist die Überprüfung von Kalibrierverfahren, um zu sehen, ob weitere Effizienzgewinne erzielt werden können (ohne die Qualität der Daten zu beeinträchtigen). Vor vielen Jahren war die Technologie eher mechanischer Natur. Die Komponenten auf den Platinen waren zahlreicher/komplexer und die Geräte waren empfindlicher gegenüber den Umgebungsbedingungen. Die intelligente Technologie von heute bietet mehr Genauigkeit und „Gehirnleistung“ mit weniger und vereinfachten Komponenten sowie verbesserten Kompensationsmöglichkeiten. In vielen Fällen haben sich – mittlerweile überholte – Prüfverfahren nicht mit der Technologie weiterentwickelt. Ein gutes Beispiel hierfür ist ein älterer DMS-Drucksensor, der beim Start (beginnend bei Null) mit Druckanstieg aus einem entspannten Zustand eine negative Abweichung aufweist. Wird das Messelement auf seinen Maximaldruck angefahren und nimmt der Druck wieder ab, wird dieser durch einen mechanischen Speicher so „verzerrt“, dass es eine positive Abweichung gibt. Dieses Phänomen wird als Hysterese bezeichnet und ähnelt der in der vierten Grafik dargestellten Kalibrierung.

Abbildung 4: 5 Punkte aufwärts/abwärts-Kalibrierung mit Hysterese

.jpg?width=750&name=Graph%204_with%20hys_(GER).jpg)

Die modernen intelligenten Drucksensoren sind stark verbessert; eine Hysterese würde nur dann auftreten, wenn etwas mit dem Sensor nicht stimmt und/oder dieser beschädigt wurde. Würde dieselbe Prüfung an einem modernen Sensor durchgeführt, sähe die Darstellung folgendermaßen aus (Grafik 5).

Abbildung 5: 5 Punkte aufwärts/abwärts-Kalibrierung ohne Hysterese

.jpg?width=750&name=Graph%205_no%20hys_(GER).jpg)

Dies mag auf den ersten Blick einfach aussehen; es erfordert jedoch einen erheblichen Aufwand für einen Kalibriertechniker eine manuelle Druckkalibrierung mit einer Handpumpe durchzuführen. Beim Wert 0 zu kalibrieren ist relativ einfach. In der Regel wird aber für eine Fehlereinschätzung auf Grundlage eines „ungewöhnlichen“ mA-Signals versucht, einen genauen Druckmesspunkt zu „treffen“. Sollen z.B. 25 in H2O genau 8 mA betragen, aber es werden 8,1623 mA angezeigt, wenn der Druck auf exakt 25 in H2O eingestellt ist, weiß ein erfahrener Techniker, dass er es mit einem 1%-igen Messspannenfehler zu tun hat (0,1623 ÷ 16 x 100 = 1%). Der Aufwand einen Kalibrierpunkt genau zu treffen ist zeitintensiv; insbesondere bei einem sehr niedrigen Druck von 25 in H2O. Eine 9-Punkte-Kalibrierung durchzuführen kann 5 Minuten oder mehr in Anspruch nehmen und diese Kalibrierung unnötig in die Länge ziehen. Die Zeit kann durch eine 5-Punkte-Prüfung halbiert werden – die Grafik sähe identisch aus, weil die “abwärts“-Kalibrierpunkte keine neue Information liefern. Ein Drucksensor arbeitet jedoch nach wie vor mechanisch und könnte eine Hysterese aufweisen. Die Durchführung einer 3-Punkte-aufwärts/abwärts-Prüfung an einem Drucktransmitter wäre eine bewährte Methode. Die Datenqualität entspräche der 9-Punkte-Prüfung und eine vorliegende Hysterese würde erkannt werden. Dieses bedeutet auch eine Reduzierung des Aufwands für den Techniker, weil es nur 3 „schwierige“ Prüfpunkte (bei Null ist es einfach) im Vergleich zu 4 Punkten für eine 5-Punkte-Prüfung und 7 Punkten für eine 9-Punkte-aufwärts/abwärts-Prüfung gibt. Im Laufe der Zeit können erhebliche Einsparungen erzielt und die tägliche Arbeit des Technikers erleichtert werden.

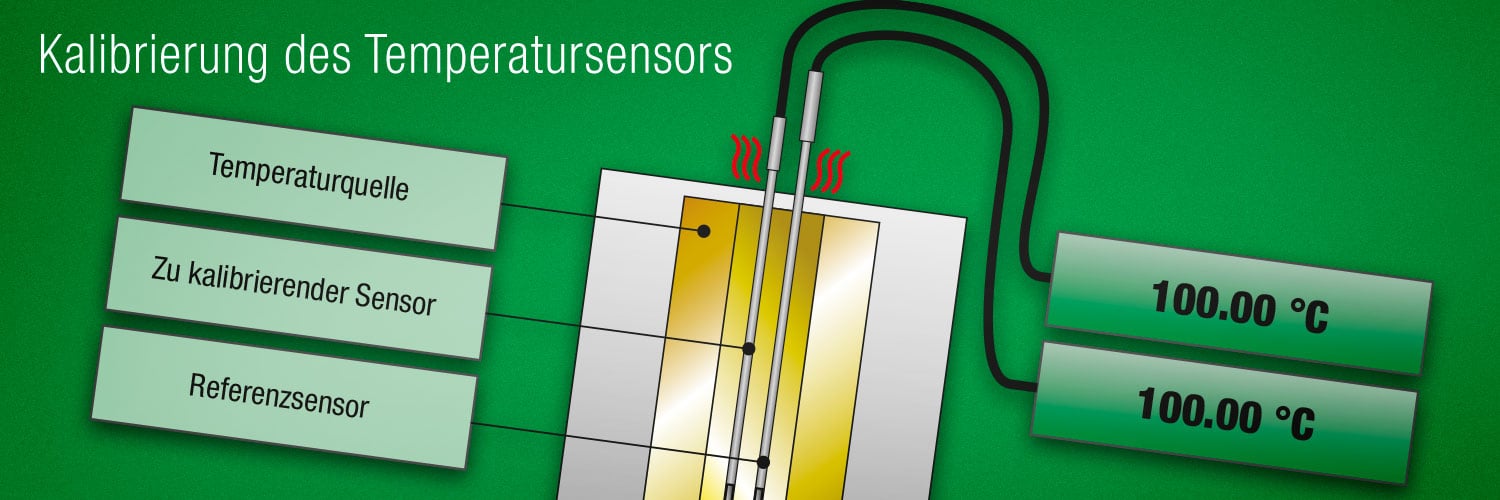

Der gleiche Ansatz kann auch bei Temperaturmessgeräten angewendet werden. Der elektromechanische Temperatursensor (RTD oder Thermoelement) weist normalerweise keine Hysterese auf – was auch immer bei einem Temperaturanstieg geschieht, ist bei einem Temperaturabfall wiederholbar. Am häufigsten tritt eine „Nullpunktverschiebung“ auf, die auf einen thermischen Schock oder eine physische Beschädigung hinweist („raue“ Betriebsbedingungen oder der Sensor ist heruntergefallen). Ein Temperaturtransmitter ist ein elektronisches Gerät und besitzt durch seine moderne, intelligente Technologie hervorragende Messeigenschaften. Daher empfiehlt es sich eine einfache 3-Punkte-Prüfung an Temperaturmessgeräten durchzuführen. Wenn ein Sensor in einem Trockenblock oder Bad geprüft wird, wäre die Prüfung von mehr als 3 Punkten eine reine Zeitverschwendung; es sei denn es wird hohe Genauigkeit gefordert oder ein anderer praktischer Grund liegt vor.

Für die Optimierung von Prüfparametern gibt es noch weitere Beispiele. Beim Kalibrieren sollte man sich an den Prozess anlehnen; wenn dieser nie unter 100°C sein wird, warum dann bei Null prüfen? Bei Verwendung eines Trockenblocks kann es sehr lange dauern bis ein Kalibrierpunkt von 0 °C oder darunter erreicht wird. Warum nicht den ersten Prüfpunkt bei 5 °C (mit einem zu erwartenden Ausgang von 4,8 mA) festlegen, wenn sich dies als praktisch erweist und Zeit einspart sowie das Prüfen erleichtert? Ein weiteres Beispiel ist die Kalibrierung eines Differenzdruck-Durchflussmessers mit Quadratwurzelfunktion. Da eine Durchflussrate gemessen wird, sollten die Prüfpunkte im Ausgang 8 mA, 12 mA, 16 mA und 20 mA betragen und nicht auf gleichmäßigen Druckeingangs-Schritten basieren. Diese Technologie umfasst außerdem eine Minimalstromabschaltung bei der ein sehr geringer Durchfluss nicht messbar ist. Bewährt hat sich das Prüfen an einem ersten Kalibrierpunkt mit einem Ausgang von 5,6 mA (der bei nur 1% der Eingangs-Messspanne sehr nahe Null liegt).

Vernachlässigen Sie nicht auf welche Weise Prüfungen durchgeführt werden. Wofür unnötige Daten sammeln? Dies führt dazu, dass viele Informationen verarbeitet werden müssen. Dadurch werden hohe Kosten verursacht. Warum den Vorgang der Kalibrierung also erschweren? Werten Sie die historischen Daten aus, die Ihnen zu Entscheidungen verhelfen, um Ihre Arbeit ohne Qualitätseinbußen zu vereinfachen.

Kalibriertrendanalyse und Kosten

Beispiel für einen Temperaturtransmitter

Zur Optimierung der Kalibrierplanung sollten, wie bereits erwähnt, die historischen Daten analysiert werden. Es besteht ein Gleichgewicht zwischen Prozessleistung vs. Gerätedrift vs. Toleranz vs. optimalem Intervall vs. Kalibrierkosten. Die einzige Möglichkeit dies effektiv zu bestimmen ist die Überprüfung historischer Daten. Wenden Sie – mit ähnlichen Daten für das Beispiel des Temperaturtransmitters im Abschnitt Toleranz-Fehlergrenzen – die Konzepte zur Optimierung des Kalibrierplans unter folgendem Szenario an (Grafik 6):

Abbildung 6: Beispiel für einen historischen Trend

%20(GER)_1.jpg?width=790&name=Graph%206%20(History)%20(GER)_1.jpg)

Zwischen dem Anlagenverantwortlichen und den Kalibriertechnikern wurde für die Messstelle ursprünglich eine Toleranz von ±0,5% der Messspanne vereinbart. Die Toleranz wurde geändert, als mehr Informationen zur Verfügung standen und eine Toleranz von ±1% als akzeptabel erachtet wurden.

Da diese spezielle Messung als „kritisch“ betrachtet wurde, einigten sie sich darauf vorerst alle drei Monate zu kalibrieren. Zum Ende des ersten Jahres wurde eine Drift von etwa +0,25% der Messspanne pro Jahr beobachtet und es wurden keine Justagen vorgenommen. Weitere Gespräche ergaben, dass die Toleranz auf ±0,5% der Messspanne gesenkt (was den Kalibriertechniker freute) und das Intervall auf sechs Monate erhöht werden würde. 1 1/2 Jahre nach der ersten Kalibrierung wurde schließlich eine Justage vorgenommen. Zum Ende des zweiten Jahres war keine Justage erforderlich und das Intervall wurde um ein Jahr verlängert. Nach Beendigung des dritten Jahres wurde eine Justage vorgenommen, und das Intervall auf weitere 18 Monate erhöht (nun waren auch der Betriebsleiter, der Leiter der Mess- und Regeltechnik und der Kalibriertechniker zufrieden). Dies geschah alles ohne einen einzigen Fehler, der eine besondere Berichterstattung oder andere Mühen erfordert hätte.

Selbstverständlich ist dieses Szenario ein perfektes Beispiel. Werden aber mehrere Geräte desselben Herstellers/Modells eingesetzt und es stehen aussagekräftige Trends mit „guten“ historischen Daten zur Verfügung (durch die sich bewährte Verfahren bestätigen) ermöglichen es diese, die besten Entscheidungen zu treffen. Bei kritischen Messungen bevorzugen es die meisten Ingenieure konservative Verfahren einzusetzen und „über das Ziel hinaus zu kalibrieren“. Dieses Beispiel sollte Diskussionen darüber animieren, wie smarter gearbeitet, Zeit und Energie gespart und eine sichere Umgebung ohne Qualitätseinbußen erhalten werden können.

Kalibrierkosten

Es hat es sich bewährt nach Möglichkeit die Kosten für die Durchführung einer Kalibrierung zu ermitteln und diese in den Entscheidungsprozess einzubeziehen. Es sollten nicht nur die Arbeitsstunden berücksichtigt werden, sondern auch die Kosten für die Prüfgeräte; einschließlich der jährlichen Kosten für eine Rekalibrierung. Informationen zu Intervallen und Toleranzen können eine besonders wichtige Rolle bei fundierten Entscheidungen spielen.

Hochwertige Kalibrierungen können nicht mit unzureichenden Prüfgeräten durchgeführt werden. Um beispielsweise eine besonders geringe Druckmesstoleranz einzuhalten, sollte anstelle eines einfachen Druckkalibrators eine Druckwaage eingesetzt werden – dies bedeutet jedoch einen großen Anstieg der Gerätekosten und erfordert erfahrenere und besser geschulte Techniker. Durch die Auflistung aller zusätzlichen Kosten, die mit einer solchen Messung verbunden sind, könnte ein guter Kompromiss erzielt werden. Der Nutzen könnte gegenüber den Risiken von häufigeren Prüfungen mit weniger präzisen Geräten – oder dem Einsatz alternativer Prüfmittel – ermittelt werden.

Ein weiterer oft unterschätzter, jedoch notwendiger Betriebskostenfaktor, ist es in Personal und Ausrüstung zu investieren. Die Wartungs- und/oder Prüfverfahren sollten sowohl bei neuen Technologien als auch Prüfgeräten immer durch entsprechende Schulungen verstärkt werden. ISA bietet den Kalibriertechnikern mehrere ausgezeichnete Schulungsmöglichkeiten und fördert lokale Programme, die über Handelsschulen oder branchenspezifischen Seminaren abgehalten werden. Letztlich sollte eine jährliche Überprüfung des Kalibrier-Equipments erfolgen; Reinvestitionen können so durch den Ersatz des alten Equipments begründet werden. Die jährlichen Rekalibrierungskosten können u.U. hoch ausfallen. Achten Sie daher bei der Auswahl neuer Kalibriergeräte darauf, dass dieses möglichst viele Einzelgeräte ersetzt.

Ein weiterer wichtiger Kostenfaktor sind die Ausfallkosten. Was geschieht, wenn beispielsweise ein für den Prozess kritisches Gerät ausfällt? Bei Audits oder bei potenziellen Problemen bei Abschaltungen ist es unerlässlich ein hochwertiges Kalibrierprogramm zu haben, sodass Probleme erkannt werden bevor sie beginnen und ein langwieriger Wiederherstellungsprozess erspart bleibt. Welche Auswirkungen hat beispielsweise eine Prüfausrüstung mit einem ausgefallenen Modul auf alle im vergangenen Jahr durchgeführten Kalibrierungen? Werden solche Risiken und die damit verbundenen Kosten berücksichtigt, können richtige Entscheidungen getroffen und die richtigen Investitionen getätigt werden.

Fazit

Offensichtlich bieten nicht alle Geräte einfache Möglichkeiten Analysen durchzuführen, um Drifts vorherzusagen. Zudem werden Kalibrierabläufe unterbrochen und während eines Ausfalls muss eine sorgfältige Planung außer Acht gelassen werden. In einigen regulierten Bereichen gibt es spezielle Anforderungen oder Standards bzw. Qualitätssysteme, die festlegen wie häufig Geräte kalibriert werden müssen. — Mit Auditoren darüber zu diskutieren ist oft keine leichte Aufgabe. Die Erstellung eines speziell für kritische Geräte geeigneten Vorgehens hat sich dafür bewährt. Sobald ein Vorgehen für kritische Geräte festgelegt ist, wird Zeit zur Verfügung stehen, um eine höhere Kritikalitätsstufe zu erreichen und so weiter und so fort.

In einem guten Kalibrier-Management-Programm sollten wechselnde oder kombinierte Strategien zum Einsatz kommen. Kosten für Messkettentests können z. B. gesenkt werden, indem durchgehende Prüfungen durchgeführt und einzelne Geräte nur dann überprüft werden, wenn die Messkette nicht aktiv ist. Eine ausgeklügelte Strategie wäre eine „reduzierte“ Prüfphase in Kombination mit weniger häufigen „detaillierten“ Prüfungen vorzunehmen. Führen Sie zum Beispiel eine minimalinvasive „Stichprobenprüfung“ durch (in der Regel einen Punkt), die eine geringere Toleranz aufweist (verwenden Sie die empfohlenen 2/3 des normalen Toleranzwertes). Sollte die „Stichprobenprüfung“ als nicht bestanden eingestuft werden, wird für die erforderlichen Justagen standardmäßig eine ausführliche Prüfung durchgeführt. Ein Techniker kann eine Reihe von 10 „Stichprobenprüfungen“ durchlaufen und letztendlich nur ein oder zwei detaillierte Prüfungen für die gesamte Reihe generieren. Die „Stichproben“ sollten weiterhin dokumentiert und verfolgt werden, da von diesen Daten nützliche Informationen über die Drift gewonnen werden können.

Zusammenfassend werden mehrere bewährte Methoden genannt:

- Legen Sie ein eher konservatives Prüfintervall fest, basierend darauf, wie sich ein eventueller Ausfall auf die hochwertige und effiziente Produktherstellung auswirkt

- Nehmen Sie eine Justage erst vor, wenn die Toleranzspezifikation um 2/3 (oder ±0,67% bei einer Toleranz von ±1% der Messspanne) überschritten wird. Dies mag einem konservativ-arbeitenden Kalibriertechniker schwerfallen; ein Justageniveau von weniger als die Hälfte der Toleranz beeinträchtigt jedoch die Driftanalyse

- Fragen Sie den Kalibriertechniker, welche Toleranz für die Prozessleistung erforderlich ist, um auf sicherste Weise das hochwertigste Produkt herzustellen

- Starten Sie mit einer möglichst großen Toleranz; erfassen Sie dann einige Daten und verringern die Toleranz, um anhand eines geeigneten Intervalls optimale Ergebnisse zu erzielen

- Führen Sie eine 3-Punkte-aufwärts/abwärts-Kalibrierung an einem Drucktransmitter durch. Die Qualität der Daten entspricht der einer 9-Punkte-Prüfung; liegt eine Hysterese vor, wird diese erkannt.

- Führen Sie eine einfache 3-Punkte-Prüfung an Temperaturmessgeräten durch. Wenn ein Sensor in einem Trockenblock oder Bad kalibriert wird, wäre das Prüfen von mehr als 3 Punkten reine Zeitverschwendung; es sei denn, es wird hohe Genauigkeit gefordert oder ein anderer praktischer Grund liegt vor.

- Testen Sie einen Differenz-Drucktransmitter mit Quadratwurzelfunktion für Druckflussmessungen an einem Startkalibrierpunkt mit einem Ausgang von 5,6 mA (der bei nur 1% der Eingangs-Messspanne sehr nahe Null liegt). Da eine Durchflussrate gemessen wird, sollten die Prüfpunkte für den sequenziellen Ausgang 8 mA, 12 mA, 16 mA und 20 mA betragen und nicht auf gleichmäßigen Druckeingangs-Schritten basieren.

- Versuchen Sie nach Möglichkeit, die Kosten für die Durchführung einer bestimmten Kalibrierung zu ermitteln und in den Entscheidungsprozess einzubeziehen.

- Erstellen Sie für die kritischsten Geräte ein geeignetes Programm; sobald dieses erfasst ist, wird Zeit zur Verfügung stehen, um die nächste Kritikalitätsstufe zu erreichen und so weiter und so fort.

Denken Sie immer daran, dass Geräte driften; manche eignen sich für die Verwendung besser als andere Geräte. Der Prüfplan hängt von der festgelegten Toleranz ab. Über das Dokumentieren kann ein optimales Prüfintervall bestimmt werden, wenn systematische Fehler (Drift) von zufälligen Fehlern („Rauschen“) zu unterscheiden sind und ein systematisches Muster auftritt. Eine ausgeklügelte Toleranz-/Intervall-Kombination liefert geeignete Kontrolldaten für Effizienz, Qualität und Sicherheit mit niedrigsten Kalibrierkosten und minimalen Problemen bei Audits und/oder “Bedenken“. Bewährte Methoden sollten für die Kalibrierung kontinuierlich weiterentwickelt werden; die Technologie verändert sich stetig; die Prüfungen sollten sich daher mitentwickeln. Wie bereits erwähnt, gibt es viele Variablen, die Einfluss auf ordnungsgemäße Prüfungen haben. Durch die Festlegung der in der Prozessebene beobachteten Leistung der Messbasis können smarte Entscheidungen getroffen (und geändert) werden, was ein optimales Arbeiten ermöglicht.

Laden Sie diesen Artikel als kostenlose PDF-Datei herunter, indem Sie auf das folgende Bild klicken:

BEAMEX-LÖSUNGEN

Alle Grafiken in diesem Beitrag wurden mit der Beamex CMX Kalibrier-Management-Software erstellt.

Mit der CMX Kalibrier-Management-Software können Sie Ihre gesamten Kalibrierarbeiten und -ausrüstungen planenen, verwalten, analysieren und dokumentieren. In Kombination mit unseren dokumentieren Kalibratoren wird Ihr gesamter Kalibrierprozess digitalisiert und automatisiert.

Verwandte Blog-Beiträge

Sollten Sie diesen Artikel interessant gefunden haben, könnten

Ihnen auch diese Blog-Beiträge gefallen:

- Wie häufig sollten Instrumente kalibriert werden?

- Messunsicherheit für Nicht-Mathematiker

- Kalibrierung außerhalb der Toleranz: Was bedeutet das?

- Kalibrierung außerhalb des Toleranzbereichs - Was ist jetzt zu tun? (Teil 2)

Gerne abonnieren!

Wenn Ihnen diese Artikel gefallen, abonnieren Sie diesen Blog, indem Sie Ihre E-Mail-Adresse in das Feld "Abonnieren" oben rechts eintragen. Sie werden per E-Mail benachrichtigt, wenn neue Artikel verfügbar sind.

Originaler Post: Optimal Calibration Parameters for Process Instrumentation

.png)

.jpg)

Diskussion